Административна информация

| Заглавие | Въведение в ориентирания към човека изкуствен интелект |

| Продължителност | 60 |

| Модул | A |

| Типна урока | Лекция |

| Фокус | Етични |

| Тема | Етика на AI |

Ключови думи

Регулиране на технологиите, социален контрол на технологиите, технологична зависимост, бъдеще на труда, машинна етика, морално включване на машините, IEEE P7000, AIA

Цели на обучението

Очаквана подготовка

Учебни събития, които трябва да бъдат завършени преди

Ние ще добавим това съдържание в най-скоро време.

Задължително за учениците

Ние ще добавим това съдържание в най-скоро време.

Незадължително за студенти

Всички източници на историята на технологиите от 20-ти век.

Фон за студенти

- Етика на ИИ (Coeckelbergh): Въведение

- Текст на Акта за ИИ на ЕС

- Текст на IEEE P7000—2021

Препоръчва се за учители

- Станфордска енциклопедия на философията (SEP), Машинна етика: https://plato.stanford.edu/entries/ethics-ai/#MachEthi

- Сеп автоматизация и заетост: https://plato.stanford.edu/entries/ethics-ai/#AutoEmpl

- Изкуствени морални агенти: https://plato.stanford.edu/entries/ethics-ai/#ArtiMoraAgen

- Héder, M. (2021 г.). AI и възкресението на технологичния детерминизъм. INFORMÁCIÓS TÁRSADALOM: TÁRSADALOMTUDOMÁNYI FOLYÓIRAT, 21(2), 119—130.

- Кокелбърг, Марк. Етика на ИИ. MIT Press, 2020 г. Страници в категория: 1—2 (Intro & Superintelligence), 5 (технология), 9 (Bias). Други глави също са много добри, но незадължителни.

- Етични насоки за надежден ИИ, https://op.europa.eu/en/publication-detail/-/publication/d3988569-0434-11ea-8c1f-01aa75ed71a1

- Колингридж, Д. (1982 г.). Социалният контрол на технологиите. Отворена университетска преса.

- Казим, Емре и Кошияма, Адриано, Преглед на високо равнище на етиката на ИИ (24 май 2020 г.). http://dx.doi.org/10.2139/ssrn.3609292

Инструкции за учители

Теми за покриване

- История на социалния контрол на технологиите от Втората световна война до наши дни (15 мин.)

- Защо обществото иска да контролира все повече и повече това, което правят инженерите

- Защо е спешно сега? (10 мин.)

- Кратка история на изкуствения интелект и неотдавнашните пробиви

- Настоящата вълна от закони и етични насоки (10 мин.)

- Като например EU AIA, IEEE P70xx, ОИСР, ЮНЕСКО, WEF…

- Защо този господар е важен? (10 мин.)

- Систематично изучаване на етиката на ИИ

- Кратък преглед на главния HCAIM/модул А (15 минути)

- Цел: какво ще знаят в крайна сметка, какви възможности ще практикуват и т.н.

- Какви теми ще бъдат обсъдени по време на курса?

Видео лекции

По-нататъшно четене и преглед на регулирането на технологиите

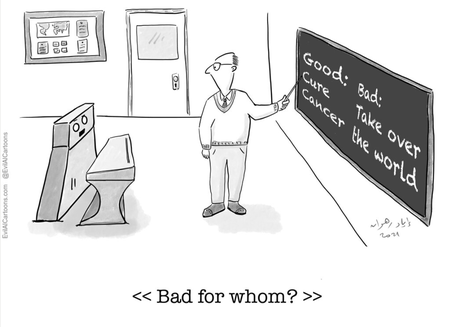

Етичните въпроси около ИИ са многобройни и разнообразни.

Тези проблеми предизвикаха особено голямо внимание от страна на различни групи, като политици, индустриални органи, практикуващи юристи и широката общественост.

Най-важните резултати от това внимание са следните:

- EU ARTIFICIAL INTELLIGENCE ACT 21.4.2021 COM(2021) 206 (предстои да бъде ратифициран през 2022 г.?)

- IEEE 7000—2021 Стандартен моделен процес за справяне с етичните проблеми по време на проектирането на системата (приет през пролетта на 2021 г.)

- Препоръка на ЮНЕСКО относно етиката на изкуствения интелект (приета от членовете през ноември 2021 г.)

- Препоръка на ОИСР относно изкуствения интелект (2019 г.)

Някои от по-важните подкрепящи теоретични документи:

- Принципина IEEE Ethically Aligned Design (2019 г.)

- Бяла книга на ЕС за изкуствения интелект COM(2020) 65 (2020 г.)

- Насоки на ЕС по въпросите на етиката за надежден ИИ (2019 г.)

- Подготовка за бъдещето на изкуствения интелект (доклад до Белия дом) 2016 г.

Някои производни работи с нормативно намерение:

Потвърждения

Магистърската програма за изкуствен интелект, насочена към човека, беше съфинансирана от Механизма за свързване на Европа на Европейския съюз с безвъзмездни средства №CEF-TC-2020—1 Цифрови умения 2020-EU-IA-0068.

Материалите на това учебно събитие са достъпни под CC BY-NC-ND 4.0