Administratívne informácie

| Názov | Šírenie dopredu |

| Trvanie | 60 |

| Modul | B |

| Druh lekcie | Tutorial |

| Zameranie | Technické – hĺbkové učenie |

| Téma | Predbežná priepustnosť |

Kľúčové slová

Predné prihrávky, Strata,

Vzdelávacie ciele

- Pochopte proces predchodcu

- Pochopte, ako vypočítať predikciu prechodu dopredu, ako aj stratu odpojenú

- Vyvinúť predný priechod bez modulov v Pythone (iné ako Numpy)

- Vytvorte si prechod dopredu pomocou Keras

Očakávaná príprava

Naučte sa udalosti, ktoré treba dokončiť predtým

Povinné pre študentov

Žiadne.

Voliteľné pre študentov

- Násobenie matríc

- Začať s Numpy

- Znalosť lineárnej a logistickej regresie ([Lecture: Lineárna regresia]

Referencie a zázemie pre študentov

- John D Kelleher a Brain McNamee (2018), Základy strojového učenia pre prediktívnu dátovú analytiku, MIT Press.

- Michael Nielsen. (2015), Neural Networks and Deep Learning (Neurálne siete a hlboké učenie), 1. Kľúčové slová, San Francisco CA USA.

- Charu C. Aggarwal. (2018), Neural Networks and Deep Learning (Neurálne siete a hlboké učenie), 1. Springer

- Antonio Gulli, Sujit Pal. Hlboké učenie s Keras, Packt, [ISBN: 9781787128422].

Odporúčané pre učiteľov

Žiadne.

Učebné materiály

- [Problém 1 (obrázok)]

- [Problém 2 a problém 3 (HTML)]

- Problém 2 a problém 3 (.ipynb)

Pokyny pre učiteľov

- Tento tutoriál predstaví študentom základy šírenia dopredu pre umelú neurónovú sieť. Tento výukový program bude pozostávať z prednej prihrávky pomocou pera a papiera, pomocou Python len s knižnicou Numpy (pre manipuláciu s matricami) a potom pomocou KERAS. To bude vychádzať zo základného chápania toho, aké aktivačné funkcie sa vzťahujú na špecifické problémové kontexty a ako sa aktivačné funkcie líšia vo výpočtovej zložitosti a v aplikácii z pera a papiera, na kód od nuly pomocou Numpy a potom pomocou modulu vysokej úrovne -> Keras.

- Študenti budú mať tri problémy:

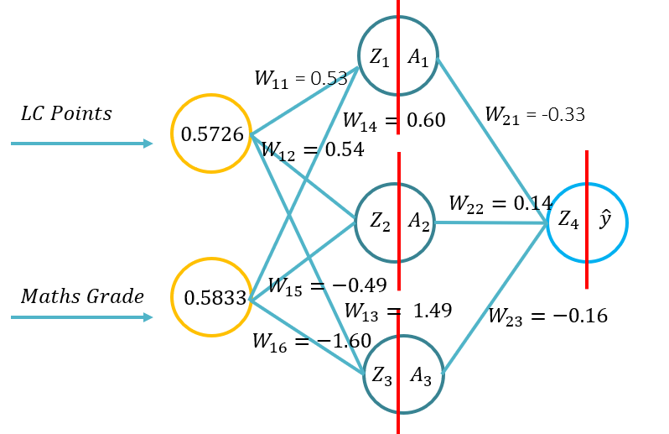

- Problém 1: (Príklad 1 z prednášky -> Obrázok na RHS tohto WIKI) a požiadal o vykonanie prihrávky s použitím nasledujúcich parametrov (20 minút na dokončenie):

- Sigmoidná aktivačná funkcia pre skrytú vrstvu

- Sigmoidná aktivačná funkcia pre vonkajšiu vrstvu

- Funkcia straty MSE

- Problém 2: (Príklad 1 z prednášky), študenti budú požiadaní (s usmernením v závislosti od predchádzajúcej skúsenosti s kódovaním), aby vyvinuli neurónovú sieť od nuly pomocou modulu Numpy a závažia a aktivačné funkcie z problému 1 (ktoré sú rovnaké ako príklad 1 z prednášky (20 minút na dokončenie).

- Problém 3: (Príklad 1 z prednášky a s použitím rovnakého príkladu, ale náhodných váh), študenti budú požiadaní (s usmernením v závislosti od predchádzajúcej skúsenosti s kódovaním), aby vyvinuli neurónovú sieť pomocou modulu Tensorflow 2.X s modulom inbuild Keras a závažiami a aktivačnými funkciami z problému 1 a potom pomocou náhodných závaží (ktoré sú rovnaké ako príklad 1 z prednášky: 20 minút na dokončenie).

- Problém 1: (Príklad 1 z prednášky -> Obrázok na RHS tohto WIKI) a požiadal o vykonanie prihrávky s použitím nasledujúcich parametrov (20 minút na dokončenie):

- Podcieľom týchto troch problémov je zvyknúť si študentov na štruktúru a aplikáciu základných konceptov (aktivačné funkcie, topológia a stratové funkcie) pre hlboké učenie.

- Keras a TensorFlow 2.X sa používajú a budú použité pre všetky budúce príklady.

Obrysy

| Trvanie (Min) | Popis |

|---|---|

| 20 | Problém 1: Pero a papierová implementácia prihrávky (príklad z prednášky) |

| 20 | Problém 2: Rozvoj neurónovej siete od nuly pomocou Numpy (príklad z prednášky) |

| 10 | Problém 3: Rozvoj neurónovej siete z používania Keras (príklad z prednášky s nastavenými závažiami a náhodnými váhami) |

| 10 | Rekapitulácia na proces odovzdávania dopredu |

Uznania

Program Masters umelej inteligencie zameraný na človeka bol spolufinancovaný z Nástroja Európskej únie na prepájanie Európy v rámci grantu CEF-TC-2020 – 1 Digitálne zručnosti 2020-EU-IA-0068.