Administrativní informace

| Název | Šíření vpřed |

| Trvání | 60 |

| Modul | B |

| Typ lekce | Tutoriál |

| Soustředění | Technické – hluboké učení |

| Téma | Průjezd dopředu |

Klíčová slova

Průsmyk dopředu, ztracený,

Vzdělávací cíle

- Pochopte proces průjezdu dopředu

- Pochopte, jak vypočítat predikci forward passu, stejně jako ztrátu unplugged

- Vyvinout forward pass pomocí žádných modulů v Pythonu (jiné než Numpy)

- Vytvořit průsmyk dopředu pomocí Keras

Očekávaná příprava

Vzdělávací akce, které mají být dokončeny před

Povinné pro studenty

Žádné.

Volitelné pro studenty

- Násobení matricí

- Začínáme s Numpy

- Znalost lineární a logistické regrese ([Přednáška: Lineární regrese]

Reference a zázemí pro studenty

- John D Kelleher a Brain McNamee. (2018), Základy strojového učení pro prediktivní datovou analýzu, MIT Press.

- Michael Nielsen. (2015), neuronové sítě a hluboké učení, 1. Determinační tisk, San Francisco CA USA.

- Charu C. Aggarwal. (2018), Neural Networks and Deep Learning, 1. Springer

- Antonio Gulli, Sujit Pal. Hluboké učení s Keras, Packt, [ISBN: 9781787128422].

Doporučeno pro učitele

Žádné.

Materiály pro výuku

- [Problém 1 (obrázek)]

- [Problém 2 a problém 3 (HTML)]

- Problém 2 a problém 3 (.ipynb)

Pokyny pro učitele

- Tento tutoriál seznámí studenty se základy šíření vpřed pro umělou neuronovou síť. Tento tutoriál se bude skládat z předávacího průchodu pomocí pera a papíru, pomocí Pythonu pouze s knihovnou Numpy (pro manipulaci s maticemi) a pak pomocí KERASu. To bude vycházet ze základního pochopení toho, jaké aktivační funkce se vztahují na konkrétní problémové kontexty a jak se aktivační funkce liší výpočetní složitostí a aplikací od pera a papíru, až po kódování od nuly pomocí Numpy a pak pomocí modulu na vysoké úrovni -> Keras.

- Studenti budou mít tři problémy:

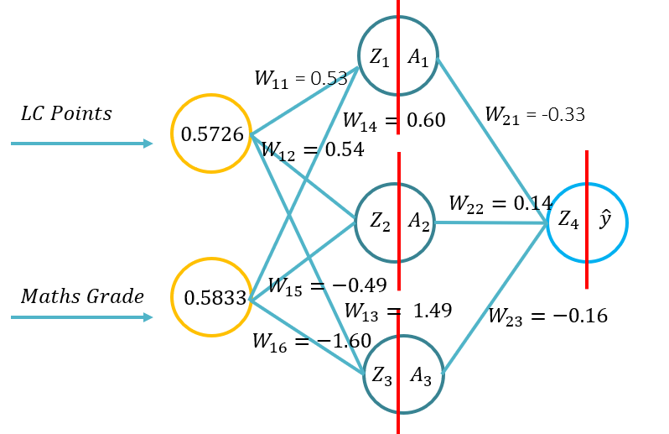

- Problém 1: (Příklad 1 z přednášky -> Obrázek na RHS tohoto WIKI) a požádal o provedení průjezdu dopředu pomocí následujících parametrů (20 minut k dokončení):

- Funkce aktivace sigmoidů pro skrytou vrstvu

- Sigmoid aktivační funkce pro vnější vrstvu

- Funkce ztráty MSE

- Problém č. 2: (Příklad 1 z přednášky) budou studenti požádáni (s pokyny v závislosti na předchozí zkušenosti s kódováním) o vytvoření neuronové sítě od nuly pomocí modulu Numpy a hmotností a aktivačních funkcí z problému 1 (které jsou stejné jako příklad 1 z přednášky (20 minut dokončit).

- Problém 3: (Příklad 1 z přednášky a pomocí stejného příkladu, ale náhodných vah), budou studenti požádáni (s pokyny v závislosti na předchozí zkušenosti s kódováním) o vytvoření neuronové sítě pomocí modulu Tensorflow 2.X s vestavěným modulem Keras a závaží a aktivačních funkcí z problému 1 a poté pomocí náhodných vah (které jsou stejné jako příklad 1 z přednášky: 20 minut k dokončení).

- Problém 1: (Příklad 1 z přednášky -> Obrázek na RHS tohoto WIKI) a požádal o provedení průjezdu dopředu pomocí následujících parametrů (20 minut k dokončení):

- Dílčí cíle pro tyto tři problémy, je, aby si studenti zvykli na strukturu a aplikaci základních konceptů (aktivační funkce, topologie a ztrátové funkce) pro hluboké učení.

- Keras a TensorFlow 2.X se používají a budou použity pro všechny budoucí příklady.

Obrys

| Doba trvání (Min) | Popis |

|---|---|

| 20 | Problém 1: Realizace pera a papíru vpřed (příklad z přednášky) |

| 20 | Problém č. 2: Vývoj neuronové sítě od nuly pomocí Numpy (příklad z přednášky) |

| 10 | Problém 3: Vývoj neuronové sítě z použití Keras (příklad z přednášky s nastavenými závažími a náhodnými závažími) |

| 10 | Rekapitulace procesu předávání dopředu |

Potvrzení

Program Human-Centered AI Masters byl spolufinancován Nástrojem Evropské unie pro propojení Evropy v rámci grantu CEF-TC-2020–1 Digitální dovednosti 2020-EU-IA-0068.