Administrativne informacije

| Naslov | Izvođenje i primjena backpropagacije |

| Trajanje | 60 |

| Modul | B |

| Vrsta lekcija | Udžbenik |

| Fokus | Tehničko – dubinsko učenje |

| Tema | Izvođenje i provedba backpropagacije |

Ključne riječi

Backpropagation, aktivacijske funkcije, devijacija,

Ciljevi učenja

- Razviti razumijevanje gradijenta i stope učenja

- Izvucite backpropagation za skrivene i vanjske slojeve

- Implimentiranje Backpropagation isključeno i priključeno pomoću različitih aktivacijskih funkcija

Očekivana priprema

Edukativni događaji koji će biti završeni prije

Obvezno za studente

- Revizija izračuna (izvedenice, djelomične izvedenice, pravilo lanca)

Neobvezno za studente

Nijedan.

Preporuke i pozadina za studente

- John D Kelleher i Brain McNamee. (2018.), Fundamentals of Machine Learning for Predictive Data Analytics (Osnove strojnog učenja za prediktivnu analizu podataka), MIT Press.

- Michael Nielsen. (2015.), Neuralne mreže i duboko učenje, 1. Resorni tisak, San Francisco CA SAD.

- Charu C. Aggarwal. (2018.), Neuralne mreže i duboko učenje, 1. Springer

- Antonio Gulli, Sujit Pal. Dubinsko učenje s Kerasom, Packtom, [ISBN: 9781787128422].

Preporučeno nastavnicima

Nijedan.

Nastavni materijali

Upute za učitelje

- Ovaj tutorial će upoznati studente s osnovama backpropagation learning algoritam za umjetnu neuronsku mrežu. Ovaj tutorial će se sastojati od izvođenja backpropagation algoritam pomoću olovke i papira, zatim primjena backpropagation algoritam za tri različite funkcije skrivenog sloja aktivacije (Sigmoid, Tan H i ReLu), koristeći Python samo s Numpy bibliotekom (za matrice manipulacije), a zatim pomoću KERAS.. To će se temeljiti na temeljnom razumijevanju različitih aktivacijskih funkcija kada neuronska mreža uči i kako se funkcije aktivacije razlikuju u računalnoj složenosti i primjeni od olovke i papira, do kodiranja od nule pomoću Numpyja, a zatim pomoću modula visoke razine -> Keras.

- Napomena: Topologija je ista kao Predavanje 1/Tutorial 1, ali utezi i ulazi su različiti, naravno možete koristiti iste utege.

- Studenti će biti predstavljeni s četiri problema (prvi je fakultativan ili kao dodatni materijal):

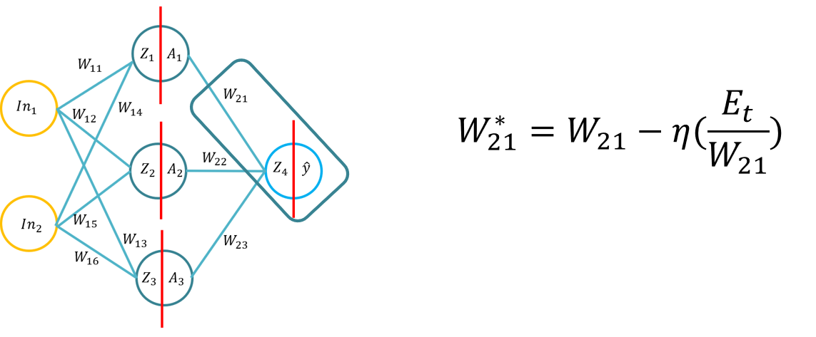

- Problem 1.: Izvođenje algoritma backpropagacije (koristeći funkciju Sigmoid za unutarnje i vanjske aktivacijske funkcije i MSE kao funkciju gubitka), od učenika će se tražiti da izvedu formulu backpropagacije (20 minuta za dovršetak).

- Drugi problem: Studenti će primijeniti tri aktivacijske funkcije za jedno ažuriranje težine (SGD backpropagation), koristeći olovku i papir za (20 minuta):

- Sigmoid (skriveni sloj), sigmoid (vanjski sloj) i MSE

- Tan H (skriveni sloj), sigmoid (vanjski sloj) i MSE

- ReLU (skriveni sloj), sigmoid (vanjski sloj) i MSE

- Treći problem: Učenici će biti zamoljeni (s uputama ovisno o prethodnom iskustvu kodiranja) da razviju neuronsku mrežu od nule koristeći samo Numpy modul, te utege i aktivacijske funkcije gdje je omogućena mogućnost odabira iz bilo koje funkcije aktivacije skrivenih slojeva za ažuriranje utega pomoću SGD-a (20 minuta za dovršetak).

- Četvrti problem: Studenti će biti zamoljeni (uz vodstvo ovisno o prethodnom iskustvu kodiranja) da razviju neuronsku mrežu pomoću Tensorflow 2.X modula s ugrađenim Keras modulom i utezima i aktivacijskim funkcijama, a zatim pomoću slučajnih utega za dovršetak jednog ili više ažuriranja težine. Molimo ne jer Keras koristi blagi gubitak MSE-a, gubitak se brže smanjuje u primjeru Keras.

- Keras MSE = gubitak = kvadrat(y_true – y_pred)

- Udžbenik MSE = gubitak = (kvadrat (y_true – y_pred)) *0.5

- Podcilj za ova tri problema je da učenici razumiju algoritam pozadinske propagacije, primjenjuju ga tako da će za ugađanje hipermetara učenici moći bolje razumjeti učinke hiperparametara.

Nacrt

| Trajanje (min) | Opis |

|---|---|

| 20 (neobvezno) | Problem 1.: izvođenje formule za backpropagaciju pomoću funkcije Sigmoid za unutarnje i vanjske aktivacijske funkcije i MSE-a kao funkcije gubitka (neobvezno) |

| 20 | Drugi problem: Studenti će primijeniti tri aktivacijske funkcije za jedno ažuriranje težine (SGD backpropagation), koristeći olovku i papir za (20 minuta): |

| 20 | Treći problem: Studenti će razviti neuronsku mrežu od nule koristeći samo Numpy modul, gdje korisnik može odabrati iz bilo koje od tri funkcije aktivacije skrivenih slojeva gdje kod može pretformirati backpropagation |

| 10 | Četvrti problem: Studenti će koristiti Tensorflow 2.X modul s ugrađenim Keras modulom, preoblikovati backpropagation pomoću SGD-a. |

| 10 | Preuzmite proces naprijed prolaza |

Priznanja

Diplomski studij umjetne inteligencije usmjeren na čovjeka sufinanciran je Instrumentom za povezivanje Europe Europske unije u okviru bespovratnih sredstava CEF-TC-2020 – 1 Digital Skills 2020-EU-IA-0068.