Hallinnolliset tiedot

| Otsikko | Relevanssin johtaminen ja levittäminen |

| Kesto | 60 |

| Moduuli | B |

| Oppitunnin tyyppi | Opetusohjelma |

| Keskittyminen | Tekninen – syväoppiminen |

| Aihe | Backpropagation johtaminen ja toteuttaminen |

Avainsanoja

Takaisinlisäys, aktivointitoiminnot, poikkeamat,

Oppimistavoitteet

- Kehittää ymmärrystä kaltevuus ja oppimisaste

- Johtaa takaisinpropagaatio piilotettuja ja ulompia kerroksia varten

- Backpropagation implimentointi irrotettuna ja kytkettynä eri aktivointitoiminnoilla

Odotettu valmistelu

Oppimistapahtumat valmistuvat ennen

Pakollinen opiskelijoille

- Calculus revision (johdannaiset, osittaiset johdannaiset, ketjusääntö)

Valinnainen opiskelijoille

Ei mitään.

Referenssejä ja taustaa opiskelijoille

- John D Kelleher ja Brain McNamee. (2018), koneoppimisen perusteet ennakoivaa data-analytiikkaa varten, MIT Press.

- Michael Nielsen. (2015), Neural Networks and Deep Learning, 1. Päättäväinen lehdistö, San Francisco CA USA.

- Charu C. Aggarwal. (2018), Neural Networks and Deep Learning, 1. Springer

- Antonio Gulli, Sujit Pal. Syväoppiminen Keras, Packt, [ISBN: 9781787128422].

Suositellaan opettajille

Ei mitään.

Oppituntimateriaalit

Ohjeita opettajille

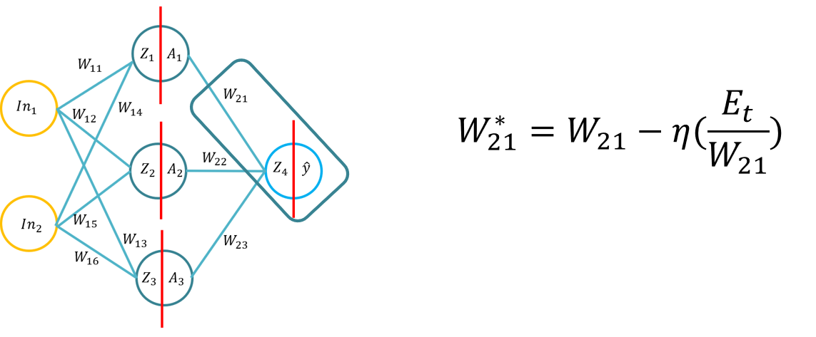

- Tämä opetusohjelma esittelee opiskelijoille backpropagation oppimisalgoritmin perusteet keinotekoiselle hermoverkolle. Tämä opetusohjelma koostuu backpropagation-algoritmin johtamisesta kynän ja paperin avulla, sitten backpropagation-algoritmin soveltamisesta kolmeen eri piilotettuun kerroksen aktivointitoimintoon (Sigmoid, Tan H ja ReLu), käyttäen Pythonia vain Numpy-kirjaston kanssa (matriisien manipulointiin) ja sitten KERAS.. Tämä perustuu perustavanlaatuiseen ymmärrykseen vaihtelevista aktivointifunktioista, kun hermoverkko oppii ja miten aktivointitoiminnot eroavat laskennallisesta monimutkaisuudesta ja sovelluksesta kynästä ja paperista koodiin Numpyn avulla ja sitten käyttämällä korkeatasoista moduulia -> Keras.

- Huom. Topologia on sama kuin luento 1/Tutorial 1, mutta painot ja panokset ovat erilaisia, voit tietenkin käyttää samoja painoja.

- Opiskelijoille esitetään neljä ongelmaa (ensimmäinen on valinnainen tai lisämateriaali):

- Ongelma 1: Backpropagation-algoritmin johtaminen (käyttäen Sigmoid-funktiota sisä- ja ulkoaktivaatiofunktioille ja MSE: lle tappiofunktiona), oppilaita pyydetään johtamaan backpropagation kaava (20 minuuttia loppuun).

- Ongelma 2: Opiskelija soveltaa kolme aktivointitoimintoa yhden painon päivitys (SGD backpropagation), käyttäen kynää ja paperia (20 minuuttia):

- Sigmoid (Piilotettu kerros), Sigmoid (Outer Layer) ja MSE

- Tan H (Piilotettu kerros), Sigmoid (Outer Layer) ja MSE

- ReLU (piilotettu kerros), Sigmoid (Outer Layer) ja MSE

- Ongelma 3: Oppilaita pyydetään (edellisestä koodauskokemuksesta riippuen) kehittämään hermoverkko tyhjästä käyttäen vain Numpy-moduulia ja painoja ja aktivointitoimintoja, joissa on mahdollisuus valita mistä tahansa piilotetusta tason aktivointitoiminnosta painojen päivittämiseksi SGD: llä (20 minuuttia loppuun).

- Ongelma 4: Oppilaita pyydetään (edellisestä koodauskokemuksesta riippuen) kehittämään hermoverkko käyttäen Tensorflow 2.X -moduulia rakennetulla Keras-moduulilla ja painot ja aktivointitoiminnot ja sitten käyttämällä satunnaisia painoja yhden tai useamman painon päivittämiseksi. Ei, koska Keras käyttää hieman erilaista MSE-tappiota, tappio vähenee nopeammin Keras-esimerkissä.

- Keras MSE = tappio = neliö(y_true – y_pred)

- Opetusohjelma MSE = tappio = (neliö(y_true – y_pred))*0.5

- Näiden kolmen ongelman alatavoitteet on saada opiskelijat ymmärtämään backpropagation-algoritmia, soveltamaan sitä niin, että hypermetriviritys, opiskelijat pystyvät paremmin ymmärtämään hyperparametrien vaikutuksia.

Hahmotella

| Kesto (Min) | Kuvaus |

|---|---|

| 20 (valinnainen) | Ongelma 1: Backpropagation kaavan johtaminen Sigmoid-funktiolla sisä- ja ulkoaktivaatiofunktioille ja MSE häviöfunktiona (valinnainen) |

| 20 | Ongelma 2: Opiskelija soveltaa kolme aktivointitoimintoa yhden painon päivitys (SGD backpropagation), käyttäen kynää ja paperia (20 minuuttia): |

| 20 | Ongelma 3: Opiskelijat kehittävät hermoverkon tyhjästä käyttäen vain Numpy-moduulia, jossa käyttäjä voi valita mistä tahansa kolmesta piilotetusta kerroksen aktivointitoiminnosta, joissa koodi voi esimuodostella backpropagation |

| 10 | Ongelma 4: Opiskelijat käyttävät Tensorflow 2.X -moduulia sisäänrakennetulla Keras-moduulilla, esimuotoilemalla takaisinpropagointia SGD: llä. |

| 10 | Yhteenveto eteenpäin suuntautuvasta läpäisyprosessista |

Tunnustukset

Human-Centered AI Masters -ohjelmaa rahoitettiin Euroopan unionin Verkkojen Eurooppa -välineestä (CEF-TC-2020–1 Digital Skills 2020-EU-IA-0068).