Administrativní informace

| Název | Šíření vpřed |

| Trvání | 60 |

| Modul | B |

| Typ lekce | Přednáška |

| Soustředění | Technické – hluboké učení |

| Téma | Průjezd dopředu |

Klíčová slova

Průjezd dopředu, ztráta,

Vzdělávací cíle

- Pochopte proces průjezdu dopředu

- Pochopte, jak vypočítat predikci forward passu, stejně jako ztrátu unplugged

- Vyvinout forward pass pomocí žádných modulů v Pythonu (jiné než Numpy)

- Vytvořit průsmyk dopředu pomocí Keras

Očekávaná příprava

Vzdělávací akce, které mají být dokončeny před

Žádné.

Povinné pro studenty

Žádné.

Volitelné pro studenty

- Násobení matricí

- Začínáme s Numpy

- Znalost lineární a logistické regrese (z období A strojového učení): Přednáška: Lineární regrese, GLR, GAD)

Reference a zázemí pro studenty

- John D Kelleher a Brain McNamee. (2018), Základy strojového učení pro prediktivní datovou analýzu, MIT Press.

- Michael Nielsen. (2015), neuronové sítě a hluboké učení, 1. Determinační tisk, San Francisco CA USA.

- Charu C. Aggarwal. (2018), Neural Networks and Deep Learning, 1. Springer

- Antonio Gulli, Sujit Pal. Hluboké učení s Keras, Packt, [ISBN: 9781787128422].

Doporučeno pro učitele

Žádné.

Materiály pro výuku

Pokyny pro učitele

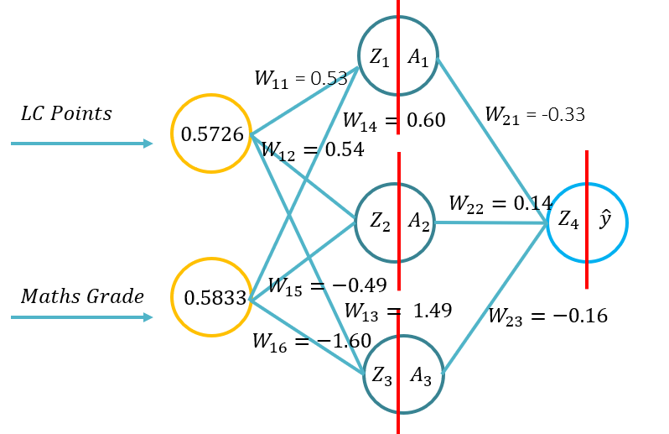

Tato přednáška seznámí studenty se základy šíření vpřed pro umělou neuronovou síť. Tím se studenti seznámí s topologií (váhy, synapse, aktivační funkce a ztrátové funkce). Studenti pak budou moci dělat dopředu průchod pomocí pera a papíru, pomocí Pythonu pouze s Numpy knihovnou (pro manipulaci s maticemi) a pak používat KERAS jako součást tutoriálu spojeného s tímto LE. To vytvoří základní pochopení toho, jaké aktivační funkce se vztahují na konkrétní problémové kontexty a jak se aktivační funkce liší výpočetní složitostí. V přednášce bude zkoumána funkce aktivace vnější vrstvy a odpovídající ztrátové funkce pro případy použití, jako je binomická klasifikace, regrese a klasifikace více tříd.

- Přehled neuronové sítě

- Definice pojmů/složek

- Závaží a aktivační funkce

- Funkce ztráty, pro kterou problémový kontext

- Použití matric pro vedení průsmyku vpřed

Poznámka:

- Použití Sigmoid ve vnější vrstvě a MSE jako funkce ztráty.

- S omezeními tine byl zvolen singulární přístup/topologie/problémový kontext. Typicky by člověk začal s regresí pro forward pass (s MSE jako ztrátovou funkcí) a pro odvození backpropagation (tedy s lineární aktivační funkcí ve výstupní vrstvě, kde to snižuje složitost derivace funkce backpropagation), pak by se typicky přesunul na binární klasifikační funkci, se sigmoidem ve výstupní vrstvě a binární funkcí křížové ztráty. S časovým omezením bude tato sada přednášek používat tři různé příklady skrytých aktivačních funkcí, ale použije regresní problémový kontext. Pro doplnění složitosti aktivační funkce sigmoid ve výstupní vrstvě, regresního problému použitého ve dvou prvních přednáškách této sady je příklad problému založen na normalizované cílové hodnotě (0–1 na základě problému 0–100 %), takže sigmoid se používá jako aktivační funkce ve výstupní vrstvě. Tento přístup umožňuje studentům snadno migrovat mezi regresní a binární klasifikační problémy, jednoduše změnou funkce ztráty pouze v případě, že problém binární klasifikace, nebo je-li použit nenormalizovaný regresní problém, student jednoduše odstraní funkci aktivace vnější vrstvy.

- Základní komponenty jsou aplikace knihovny na vysoké úrovni, v tomto případě KERAS prostřednictvím knihovny TensorFlow 2.X.

- Pero a papír jsou volitelné a slouží pouze k zobrazení odvození a aplikace forward pass a backpropagation (pomocí příkladů z přednáškových snímků).

- Python kód bez použití knihoven na vysoké úrovni, slouží k tomu, aby ukázal, jak jednoduchá neuronová síť (pomocí příkladů z přednáškových snímků). To také umožňuje diskusi o rychlé numerické/matrices násobení a představit, proč používáme GPU/TPU jako volitelný prvek.

- Keras a TensorFlow 2.X se používají a budou použity pro všechny budoucí příklady.

Obrys

| Doba trvání (Min) | Popis |

|---|---|

| 10 | Definice komponent neuronových sítí |

| 15 | Závaží a aktivační funkce (Sigmoid, TanH a ReLu) |

| 15 | Funkce ztráty (regrese, binomická klasifikace a aktivace více tříd) |

| 15 | Použití matric pro průjezd dopředu |

| 5 | Rekapitulace na průsmyku vpředu |

Potvrzení

Program Human-Centered AI Masters byl spolufinancován Nástrojem Evropské unie pro propojení Evropy v rámci grantu CEF-TC-2020–1 Digitální dovednosti 2020-EU-IA-0068.