Upravne informacije

| Naslov | Nastavitev hiperparametrov |

| Trajanje | 60 |

| Modul | B |

| Vrsta lekcije | Predavanje |

| Osredotočenost | Tehnično – poglobljeno učenje |

| Tema | Nastavitev hiperparametrov |

Ključne besede

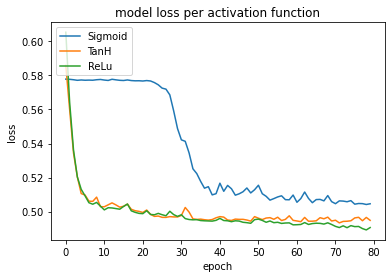

Hiperparameter tuning, aktivacijske funkcije, izguba, epohe, velikost serije,

Učni cilji

- Raziskati učinke na zmogljivost in globino

- Experient z različnimi epohami in velikostmi serij

- Preizkušanje različnih aktivacijskih funkcij in učnih stopenj

Pričakovana priprava

Učenje Dogodki, ki jih je treba dokončati pred

Obvezno za študente

Nobenega.

Neobvezno za študente

Nobenega.

Reference in ozadje za študente

- John D Kelleher in Brain McNamee. (2018), Osnove strojnega učenja za napovedno podatkovno analitiko, MIT Press.

- Michael Nielsen. (2015), Neural Networks and Deep Learning, 1. Odločni tisk, San Francisco CA ZDA.

- Charu C. Aggarwal. (2018), Neural Networks and Deep Learning, 1. Springer

- Antonio Gulli, Sujit Pal. Globoko učenje s Kerasom, Packt, [ISBN: 9781787128422].

Priporočeno za učitelje

Nobenega.

Gradivo za učne ure

Navodila za učitelje

To predavanje bo učencem predstavilo osnove hiperparametrskega tuninga. Uporabili bomo Census Dataset kot primere uporabe in rezultatov uglaševanja različnih hipermetrov. Podatkovni niz popisa odraslih je binarni problem klasifikacije. Več o tem naboru podatkov v ustrezni vadnici. Cilj tega predavanja je predstaviti več hiperparametrov s primeri, kako lahko spreminjanje teh hiperparametrov pomaga ali ovira učenje. Poleg tega navajamo primere premajhnega in prekomernega opremljanja, nosu in učinkovitosti (čas treninga in v nekaterih primerih natančnost/izguba), ko so vsi hiperparametri uglašeni. Uporabili bomo diagnostične ploskve za oceno učinka hiperparametrskega tunninga in še posebej poudarek na izgubi, kjer je treba opozoriti, da je modul, ki ga uporabljamo za risanje izgube, matplotlib.pyplot, zato se os zmanjša. To lahko pomeni, da se pri primerjavi izgube podatkov o usposabljanju ali testu lahko pojavijo pomembne razlike ali obratno. Poleg tega so predstavljene nekatere svoboščine za odre, kot je uporaba Epohs najprej (skoraj kot tehnika regularizacije), hkrati pa ohranja konstanto velikosti košare. Idealno bi bilo, da bi jih uskladili skupaj, vendar so za to predavanje ločeni.

Obris

| Trajanje (mini) | Opis |

|---|---|

| 5 | Pregled podatkov |

| 10 | Nastavitev zmogljivosti in globine (pod in nad vgradnjo) |

| 10 | Epohe (pod in nad usposabljanjem) |

| 10 | Velikosti serij (za preprečevanje hrupa) |

| 10 | Aktivacijske funkcije (in njihovi učinki na učinkovitost – čas in natančnost) |

| 10 | Stopnje učenja (vanilla, LR Decay, Momentum, Adaptive) |

| 5 | Ponovite postopek prednjega prehoda |

Priznanja

Program Masters umetne inteligence, ki je bil vključen v človeka, je bil sofinanciran z instrumentom za povezovanje Evrope Evropske unije v okviru nepovratnih sredstev (CEF-TC-2020–1 Digital Skills 2020-EU-IA-0068).