Административна информация

| Дял | Настройка на хиперпараметъра |

| Продължителност | 60 |

| Модул | Б |

| Вид на урока | Лекция |

| Фокус | Технически — задълбочено обучение |

| Тема | Настройка на хиперпараметъра |

Ключови думи

Настройка на хиперпараметъра, функции за активиране, загуба, епохи, размер на партидата,

Учебни цели

- Проучване на въздействието върху капацитета и дълбочината

- Опит с различни епохи и размери на партидите

- Изпробване на различни функции за активиране и степен на обучение

Очаквана подготовка

Обучение на събития, които трябва да бъдат завършени преди

Задължително за студентите

Няма.

Незадължително за студенти

Няма.

Референции и фон за студенти

- Джон Келър и Мозък Макнами. (2018 г.), Fundamentals of Machine Learning for Predictive Data Analytics, MIT Press.

- Майкъл Нилсън. (2015 г.), „Неврални мрежи и задълбочено обучение“, 1. Преса за решителност, Сан Франциско, САЩ.

- Чару С. Агарвал. (2018 г.), невронни мрежи и задълбочено обучение, 1. Спрингър

- Антонио Гули, Суджит Пал. Дълбоко обучение с Keras, Packt, [ISBN: 9781787128422].

Препоръчва се за учители

Няма.

Материали за уроци

Инструкции за учители

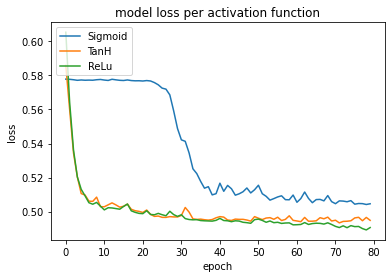

Тази лекция ще запознае студентите с основите на настройката на хиперпараметъра. Ние ще използваме набора от данни за преброяването като примери за употреба и резултати от настройка на различни хиперметри. Наборът от данни за преброяване на възрастни е двоичен проблем с класификацията. Повече за този набор от данни в съответния урок. Целта на тази лекция е да се въведат няколко хиперпараметри с примери за това как модифицирането на тези хиперпараметри може да помогне или да попречи на ученето. В допълнение, ние предоставяме примери за по-малко и прекаляване, повишаване на носа и производителността (време за обучение и в някои случаи точност/загуба), когато всеки от хиперпараметрите е туниран. Ще използваме диагностични парцели, за да оценим ефекта от тунинга на хиперпараметъра и по-специално фокуса върху загубата, където трябва да се отбележи, че модулът, който използваме за начертаване на загубата, е matplotlib.pyplot, като по този начин оста се мащабира. Това може да означава, че значителните разлики могат да изглеждат незначителни или обратно при сравняване на загубата на данните от обучението или теста. В допълнение са представени някои свободи за скелето, като например използването на Epochs на първо място (почти като техника за узаконяване), като същевременно се запазва постоянният размер на партидата. В идеалния случай те ще бъдат тунирани заедно, но за тази лекция те са разделени.

Очертаване

| Продължителност (минимум) | Описание |

|---|---|

| 5 | Преглед на данните |

| 10 | Капацитет и дълбочина тунинг (под и над монтаж) |

| 10 | Епохи (под и над обучение) |

| 10 | Размери на партидите (за потискане на шума) |

| 10 | Функции за активиране (и тяхното въздействие върху производителността — време и точност) |

| 10 | Степен на обучение (ванилия, LR Decay, момент, адаптивен) |

| 5 | Обобщение на процеса на преминаване напред |

Потвърждения

Магистърската програма по ИИ, насочена към човека, беше съфинансирана от Механизма за свързване на Европа на Европейския съюз под формата на безвъзмездни средства № CEF-TC-2020—1 Digital Skills 2020-EU-IA-0068.