Διοικητικές πληροφορίες

| Τίτλος | Ρύθμιση υπερπαράμετρου |

| Διάρκεια | 60 |

| Ενότητα | Β |

| Είδος μαθήματος | Διάλεξη |

| Εστίαση | Τεχνική — Βαθιά Μάθηση |

| Θέμα | Ρύθμιση υπερπαράμετρου |

Λέξεις-κλειδιά

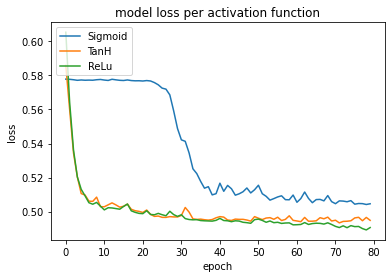

Ρύθμιση υπερπαράμετρων, λειτουργίες ενεργοποίησης, απώλεια, εποχές, μέγεθος παρτίδας,

Μαθησιακοί στόχοι

- Διερεύνηση των επιπτώσεων στην ικανότητα και το βάθος

- Βιωματική εμπειρία με διαφορετικές εποχές και μεγέθη παρτίδων

- Δοκιμή διαφορετικών λειτουργιών ενεργοποίησης και ποσοστών μάθησης

Αναμενόμενη προετοιμασία

Μαθησιακές εκδηλώσεις που πρέπει να ολοκληρωθούν πριν

Υποχρεωτικό για τους φοιτητές

Καμία.

Προαιρετικό για Φοιτητές

Καμία.

Αναφορές και υπόβαθρο για τους μαθητές

- John D Kelleher και Brain McNamee. (2018), Fundamentals of Machine Learning for Predictive Data Analytics, MIT Press.

- Ο Μάικλ Νίλσεν. (2015), Neural Networks and Deep Learning (Νευρωνικά δίκτυα και βαθιά μάθηση), 1. Αποφασιστικότητα Τύπος, San Francisco CA ΗΠΑ.

- Charu C. Aggarwal. (2018), Neural Networks and Deep Learning (Νευρωνικά δίκτυα και βαθιά μάθηση), 1. Σπρίνγκερ

- Αντόνιο Γκούλι, Σουτζίτ Παλ. Βαθιά μάθηση με Keras, Packt, [ISBN: 9781787128422].

Συνιστάται για εκπαιδευτικούς

Καμία.

Υλικό μαθήματος

Οδηγίες για τους εκπαιδευτικούς

Αυτή η διάλεξη θα εισαγάγει τους μαθητές στις βασικές αρχές του συντονισμού υπερπαράμετρων. Θα χρησιμοποιήσουμε το σύνολο δεδομένων απογραφής ως παραδείγματα της χρήσης και των αποτελεσμάτων από τη ρύθμιση διαφόρων υπερμετρητών. Το σύνολο δεδομένων απογραφής ενηλίκων είναι ένα δυαδικό πρόβλημα ταξινόμησης. Περισσότερα για αυτό το σύνολο δεδομένων στο αντίστοιχο σεμινάριο. Ο στόχος αυτής της διάλεξης είναι να εισαγάγει αρκετούς υπερπαράμετρους με παραδείγματα για το πώς η τροποποίηση αυτών των υπερπαραμέτρων μπορεί να βοηθήσει ή να εμποδίσει τη μάθηση. Επιπλέον, παρέχουμε παραδείγματα υπεξαίρεσης, βελτίωσης της μύτης και απόδοσης (χρόνος προπόνησης και σε ορισμένες περιπτώσεις ακρίβεια/απώλεια) όταν κάθε ένας από τους υπερπαράμετρους είναι τυλιγμένος. Θα χρησιμοποιήσουμε διαγνωστικά πλοκάμια για να αξιολογήσουμε την επίδραση του υπερπαράμετρου tunning και ειδικότερα την εστίαση στην απώλεια, όπου θα πρέπει να σημειωθεί ότι η μονάδα που χρησιμοποιούμε για να σχεδιάσουμε την απώλεια είναι matplotlib.pyplot, έτσι ο άξονας κλιμακώνεται. Αυτό μπορεί να σημαίνει ότι οι σημαντικές διαφορές μπορεί να μην φαίνονται σημαντικές ή το αντίστροφο κατά τη σύγκριση της απώλειας της εκπαίδευσης ή των δεδομένων δοκιμής. Επιπλέον, παρουσιάζονται ορισμένες ελευθερίες για το ικρίωμα, όπως η χρήση των Επόχων πρώτα (σχεδόν ως τεχνική τακτοποίησης), διατηρώντας παράλληλα το μέγεθος της παρτίδας σταθερό. Στην ιδανική περίπτωση, αυτά θα συντονίζονταν, αλλά γι’ αυτή τη διάλεξη είναι χωρισμένα.

Σχεδιάγραμμα

| Διάρκεια (ελάχιστη) | Περιγραφή |

|---|---|

| 5 | Επισκόπηση των δεδομένων |

| 10 | Χωρητικότητα και βάθος tunning (κάτω και πάνω από την τοποθέτηση) |

| 10 | Εποχές (κάτω και πάνω από την εκπαίδευση) |

| 10 | Μεγέθη παρτίδας (για καταστολή θορύβου) |

| 10 | Λειτουργίες ενεργοποίησης (και οι επιπτώσεις τους στην απόδοση — χρόνος και ακρίβεια) |

| 10 | Ποσοστά μάθησης (vanilla, LR Decay, Momentum, Adaptive) |

| 5 | Ανακεφαλαιοποίηση στη διαδικασία μπροστινής διέλευσης |

Αναγνωρίσεις

Το πρόγραμμα Μάστερ τεχνητής νοημοσύνης με επίκεντρο τον άνθρωπο συγχρηματοδοτήθηκε από τον μηχανισμό «Συνδέοντας την Ευρώπη» της Ευρωπαϊκής Ένωσης στο πλαίσιο της επιχορήγησης CEF-TC-2020-1 Digital Skills 2020-EU-IA-0068.