Hallinnolliset tiedot

| Otsikko | Hyperparametriviritys |

| Kesto | 60 |

| Moduuli | B |

| Oppitunnin tyyppi | Luento |

| Keskittyminen | Tekninen – syväoppiminen |

| Aihe | Hyperparametriviritys |

Avainsanoja

Hyperparametriviritys, aktivointitoiminnot, häviö, aikakaudet, erän koko,

Oppimistavoitteet

- Tutkia vaikutuksia kapasiteettiin ja syvyyteen

- Kokemus vaihtelevilla aikakausilla ja eräkokoilla

- Kokeile erilaisia aktivointitoimintoja ja oppimisasteita

Odotettu valmistelu

Oppimistapahtumat valmistuvat ennen

Pakollinen opiskelijoille

Ei mitään.

Valinnainen opiskelijoille

Ei mitään.

Referenssejä ja taustaa opiskelijoille

- John D Kelleher ja Brain McNamee. (2018), koneoppimisen perusteet ennakoivaa data-analytiikkaa varten, MIT Press.

- Michael Nielsen. (2015), Neural Networks and Deep Learning, 1. Päättäväinen lehdistö, San Francisco CA USA.

- Charu C. Aggarwal. (2018), Neural Networks and Deep Learning, 1. Springer

- Antonio Gulli, Sujit Pal. Syväoppiminen Keras, Packt, [ISBN: 9781787128422].

Suositellaan opettajille

Ei mitään.

Oppituntimateriaalit

Ohjeita opettajille

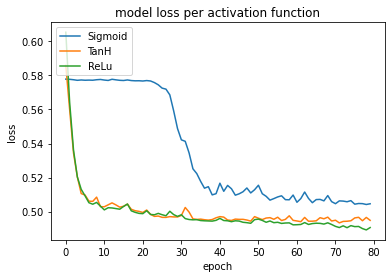

Tämä luento esittelee opiskelijoille hyperparametrivirityksen perusteet. Käytämme laskentadataa esimerkkeinä erilaisten hypermetrien virityksen käytöstä ja tuloksista. Aikuisten väestönlaskenta on binäärinen luokitteluongelma. Lisätietoja tästä aineistosta vastaavassa opetusohjelmassa. Tämän luennon tavoitteena on esitellä useita hyperparametreja, joissa on esimerkkejä siitä, miten näiden hyperparametrien muuttaminen voi auttaa tai haitata oppimista. Lisäksi tarjoamme esimerkkejä ali- ja ylisovituksesta, nenästä ja suorituskyvystä (koulutusaika ja joissakin tapauksissa tarkkuus/tappio), kun kukin hyperparametri on viritetty. Käytämme diagnostisia havaintoja hyperparametrin tunning vaikutuksen arviointiin ja erityisesti keskittymään menetykseen, jossa on huomattava, että häviön kuvaamiseen käyttämämme moduuli on matplotlib.pyplot, joten akseli skaalataan. Tämä voi tarkoittaa sitä, että merkittävät erot eivät välttämättä vaikuta merkittäviltä tai päinvastoin, kun verrataan koulutus- tai testitietojen menetystä. Lisäksi esitetään joitakin rakennustelineiden vapauksia, kuten Epochsin käyttö ensin (lähes normalisointimenetelmänä) samalla kun erän koko pysyy vakiona. Ihannetapauksessa nämä tunnettaisiin yhteen, mutta tätä luentoa varten ne erotetaan toisistaan.

Hahmotella

| Kesto (Min) | Kuvaus |

|---|---|

| 5 | Yleiskatsaus tietoihin |

| 10 | Kapasiteetti ja syvyys tunning (alle ja yli) |

| 10 | Aikakaudet (koulutus alle ja yli) |

| 10 | Eräkoot (melunvaimennus) |

| 10 | Aktivointitoiminnot (ja niiden vaikutukset suorituskykyyn – aika ja tarkkuus) |

| 10 | Oppimisasteet (vanilla, LR Decay, Momentum, Adaptive) |

| 5 | Yhteenveto eteenpäin suuntautuvasta läpäisyprosessista |

Tunnustukset

Human-Centered AI Masters -ohjelmaa rahoitettiin Euroopan unionin Verkkojen Eurooppa -välineestä (CEF-TC-2020–1 Digital Skills 2020-EU-IA-0068).