Administrative oplysninger

| Titel | Indstilling af hyperparameter |

| Varighed | 60 |

| Modul | B |

| Lektionstype | Forelæsning |

| Fokus | Teknisk — Dyb læring |

| Emne | Indstilling af hyperparameter |

Nøgleord

Hyperparameter tuning, aktivering funktioner, tab, epoker, batch størrelse,

Læringsmål

- Undersøge effekter på kapacitet og dybde

- Erfaring med varierende epoker og batchstørrelser

- Prøve forskellige aktiveringsfunktioner og læringshastigheder

Forventet forberedelse

Læringsbegivenheder, der skal fuldføres før

Obligatorisk for studerende

Ingen.

Valgfrit for studerende

Ingen.

Referencer og baggrund for studerende

- John D. Kelleher og Brain McNamee. (2018), Fundamentals of Machine Learning for Predictive Data Analytics, MIT Press.

- Michael Nielsen. (2015), Neural Networks and Deep Learning, 1. Beslutsomhed presse, San Francisco CA USA.

- Charu C. Aggarwal. (2018), Neural Networks and Deep Learning, 1. Springer

- Antonio Gulli, Sujit Pal. Dyb læring med Keras, Packt, [ISBN: 9781787128422].

Anbefalet til lærerne

Ingen.

Undervisningsmaterialer

Instruktioner til lærerne

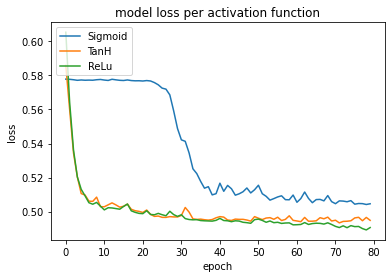

Dette foredrag vil introducere de studerende til de grundlæggende elementer i hyperparameter tuning. Vi vil bruge Census Dataset som eksempler på brug og resultater fra tuning af forskellige hypermetre. Adult Census datasættet er et binært klassifikationsproblem. Mere om dette datasæt i den tilsvarende tutorial. Formålet med dette foredrag er at introducere flere hyperparametre med eksempler på, hvordan ændring af disse hyperparametre kan hjælpe eller hindre læring. Derudover giver vi eksempler på under- og overmontering, næse- og præstationsgevinster (træningstid og i nogle tilfælde nøjagtighed/tab), når hver af hyperparametrene er tunet. Vi vil bruge diagnostiske plots til at evaluere effekten af hyperparameter tunning og især fokus på tab, hvor det skal bemærkes, at det modul, vi bruger til at afbilde tabet er matplotlib.pyplot, således aksen er skaleret. Dette kan betyde, at væsentlige forskelle kan forekomme ikke signifikante eller omvendt, når man sammenligner tabet af trænings- eller testdata. Derudover præsenteres nogle friheder for stilladser, såsom brugen af Epochs først (næsten som en regulariseringsteknik), samtidig med at batchstørrelsen holdes konstant. Ideelt set ville disse blive tunet sammen, men til dette foredrag er de adskilt.

Omrids

| Varighed (min.) | Beskrivelse |

|---|---|

| 5 | Oversigt over data |

| 10 | Kapacitet og dybdeindstilling (under og over montering) |

| 10 | Epoker (under og over uddannelse) |

| 10 | Batchstørrelser (til støjdæmpning) |

| 10 | Aktiveringsfunktioner (og deres virkninger på ydeevne — tid og nøjagtighed) |

| 10 | Læringshastigheder (vanilje, LR Decay, Momentum, Adaptive) |

| 5 | Opsummering af forward pass-processen |

Anerkendelser

Programmet Human-Centered AI Masters blev samfinansieret af Connecting Europe-faciliteten i Den Europæiske Union under tilskud CEF-TC-2020-1 Digital Skills 2020-EU-IA-0068.