Administrativní informace

| Název | Hyperparametrové ladění |

| Trvání | 60 |

| Modul | B |

| Typ lekce | Přednáška |

| Soustředění | Technické – hluboké učení |

| Téma | Hyperparametrové ladění |

Klíčová slova

Hyperparametrové ladění, aktivační funkce, ztráta, epochy, velikost dávky,

Vzdělávací cíle

- Prozkoumejte účinky na kapacitu a hloubku

- Experient s různou epochou a velikostí šarží

- Testování různých aktivačních funkcí a míry učení

Očekávaná příprava

Vzdělávací akce, které mají být dokončeny před

Povinné pro studenty

Žádné.

Volitelné pro studenty

Žádné.

Reference a zázemí pro studenty

- John D Kelleher a Brain McNamee. (2018), Základy strojového učení pro prediktivní datovou analýzu, MIT Press.

- Michael Nielsen. (2015), neuronové sítě a hluboké učení, 1. Determinační tisk, San Francisco CA USA.

- Charu C. Aggarwal. (2018), Neural Networks and Deep Learning, 1. Springer

- Antonio Gulli, Sujit Pal. Hluboké učení s Keras, Packt, [ISBN: 9781787128422].

Doporučeno pro učitele

Žádné.

Materiály pro výuku

Pokyny pro učitele

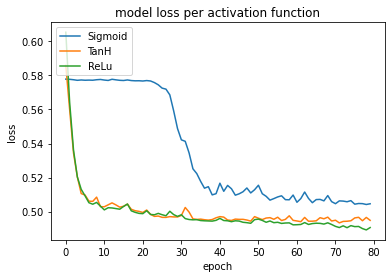

Tato přednáška seznámí studenty se základy hyperparametrového ladění. Jako příklady použití a výsledků ladění různých hypermetrů použijeme datový soubor census. Datová sada pro sčítání dospělých je problém binární klasifikace. Více o této datové sadě v příslušném tutoriálu. Cílem této přednášky je představit několik hyperparametrů s příklady toho, jak modifikace těchto hyperparametrů může pomoci nebo bránit učení. Kromě toho uvádíme příklady podmontování a přestrojení, nosu a výkonu (doba tréninku a v některých případech přesnost/ztráta), kdy je každý z hyperparametrů naladěn. Použijeme diagnostické grafy k vyhodnocení účinku hyperparametrového ladění a zejména zaměření na ztrátu, kde je třeba poznamenat, že modul, který používáme k vykreslení ztráty, je matplotlib.pyplot, čímž je osa zmenšena. To může znamenat, že významné rozdíly se při porovnávání ztráty tréninkových nebo zkušebních údajů nemusí zdát významné nebo naopak. Kromě toho jsou prezentovány některé svobody pro lešení, jako je použití epoch jako první (téměř jako technika regularizace) při zachování konstantní velikosti dávky. V ideálním případě by byly naladěny dohromady, ale pro tuto přednášku jsou odděleny.

Obrys

| Doba trvání (Min) | Popis |

|---|---|

| 5 | Přehled údajů |

| 10 | Kapacita a hloubka ladění (pod a over fit) |

| 10 | Epochy (pod a nad tréninkem) |

| 10 | Velikosti šarží (pro potlačení šumu) |

| 10 | Aktivační funkce (a jejich vliv na výkon – čas a přesnost) |

| 10 | Míra učení (vanilla, LR Decay, Momentum, Adaptive) |

| 5 | Rekapitulace procesu předávání dopředu |

Potvrzení

Program Human-Centered AI Masters byl spolufinancován Nástrojem Evropské unie pro propojení Evropy v rámci grantu CEF-TC-2020–1 Digitální dovednosti 2020-EU-IA-0068.