Hallinnolliset tiedot

| Otsikko | Eteneminen eteenpäin |

| Kesto | 60 |

| Moduuli | B |

| Oppitunnin tyyppi | Luento |

| Keskittyminen | Tekninen – syväoppiminen |

| Aihe | Etukäteispassi |

Avainsanoja

Etumatka, tappio,

Oppimistavoitteet

- Ymmärrä etukäteispassin prosessi

- Ymmärrä, miten lasketaan eteenpäin kulkeva ennuste sekä tappio irrotettuna

- Kehitetään eteenpäin kulkeva kulku, jossa ei ole moduuleja Pythonissa (muu kuin Numpy)

- Kehitä eteenpäin kulkulupa Kerasin avulla

Odotettu valmistelu

Oppimistapahtumat valmistuvat ennen

Ei mitään.

Pakollinen opiskelijoille

Ei mitään.

Valinnainen opiskelijoille

- Matriisien kertominen

- Numpyn käytön aloittaminen

- Tietoa lineaarisesta ja logistisesta regressiosta (jaksolta A Machine Learning: Luento: Lineaarinen regressio, GLR, GADs)

Referenssejä ja taustaa opiskelijoille

- John D Kelleher ja Brain McNamee. (2018), koneoppimisen perusteet ennakoivaa data-analytiikkaa varten, MIT Press.

- Michael Nielsen. (2015), Neural Networks and Deep Learning, 1. Päättäväinen lehdistö, San Francisco CA USA.

- Charu C. Aggarwal. (2018), Neural Networks and Deep Learning, 1. Springer

- Antonio Gulli, Sujit Pal. Syväoppiminen Keras, Packt, [ISBN: 9781787128422].

Suositellaan opettajille

Ei mitään.

Oppituntimateriaalit

Ohjeita opettajille

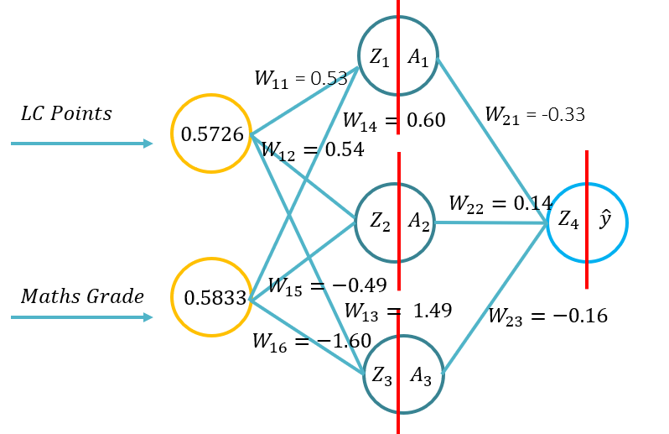

Tämä luento esittelee opiskelijat eteenpäin etenemisen perusteet keinotekoiselle neuroverkolle. Tämä tuo opiskelijoille topologian (painot, synapsit, aktivointitoiminnot ja tappiotoiminnot). Opiskelijat voivat sitten tehdä eteenpäin pass käyttäen kynää ja paperia, käyttäen Python vain Numpy kirjasto (matriisien manipulointi) ja sitten käyttää KERAS osana opetusohjelma liittyy tähän LE. Tämä rakentaa perustavaa laatua olevaa ymmärrystä siitä, mitä aktivointifunktioita sovelletaan tiettyihin ongelmakonteksteihin ja miten aktivointitoiminnot eroavat toisistaan laskennallisessa monimutkaisuudessa. Luennossa tarkastellaan ulkokerroksen aktivointitoimintoa ja vastaavia häviötoimintoja esimerkiksi binomiluokituksen, regression ja moniluokan luokittelun osalta.

- Yleiskuva neuroverkosta

- Termien/komponenttien määritelmä

- Painot ja aktivointitoiminnot

- Häviöfunktiot, joille ongelmakonteksti

- Matriisien käyttäminen etukäteispassin suorittamiseen

Huom.

- Sigmoidin käyttö ulkokerroksessa ja MSE häviöfunktiona.

- Pine-rajoituksilla valittiin yksilöllinen lähestymistapa/topologia/ongelmakonteksti. Tyypillisesti alkaisi regressio eteenpäin (MSE häviöfunktiona) ja johtaa backpropagation (jolloin on lineaarinen aktivointifunktio lähtökerroksessa, jossa tämä vähentää takaisinlisäysfunktion johtamisen monimutkaisuutta), Sitten siirryttäisiin tyypillisesti binääriseen luokitusfunktioon, jossa on sigmoidi lähtökerroksessa ja binaarinen risti-entropiahäviötoiminto. Aikarajoitusten myötä luennot käyttävät kolmea eri esimerkkiä piilotettuun aktivointiin, mutta käyttävät regressio-ongelmakontekstia. Jotta voidaan lisätä sigmoid-aktivaatiofunktion monimutkaisuus lähtökerroksessa, regressio-ongelma, jota käytetään tämän sarjan kahdessa ensimmäisessä luennossa, ongelmaesimerkki perustuu normalisoituun tavoitearvoon (0–1, joka perustuu prosenttiarvo-ongelmaan 0–1), joten sigmoidia käytetään aktivointifunktiona lähtökerroksessa. Tämän lähestymistavan avulla opiskelijat voivat helposti siirtyä regressio- ja binääriluokitusongelmien välillä yksinkertaisesti muuttamalla häviöfunktiota, jos binääriluokitusongelmaa käytetään tai jos käytetään ei-normalisoitua regressio-ongelmaa, opiskelija yksinkertaisesti poistaa ulkokerroksen aktivointifunktion.

- Ydinkomponentteja ovat korkean tason kirjaston käyttö, tässä tapauksessa KERAS TensorFlow 2.X -kirjaston kautta.

- Kynä ja paperi ovat valinnaisia, ja niitä käytetään vain eteenpäin kulkevan syötön ja takalevityksen johdannaisten ja sovellusten näyttämiseen (käyttäen esimerkkejä luentodioista).

- Python-koodia ilman korkean tason kirjastojen käyttöä käytetään osoittamaan, kuinka yksinkertainen neuroverkko (käyttäen esimerkkejä luentodioista). Tämä mahdollistaa myös keskustelun nopeasta numeerisesta/matriisien kertomisesta ja esittelee, miksi käytämme näytönohjaimia/TPU:ita valinnaisena elementtinä.

- Keras ja TensorFlow 2.X ovat käytössä ja niitä käytetään kaikissa tulevissa esimerkeissä.

Hahmotella

| Kesto (Min) | Kuvaus |

|---|---|

| 10 | Määritelmä Neural Network Components |

| 15 | Painot ja aktivointitoiminnot (Sigmoid, TanH ja ReLu) |

| 15 | Häviöfunktiot (regressio, binomiluokitus ja monen luokan aktivointi) |

| 15 | Matriisien käyttäminen eteenpäin passissa |

| 5 | Yhteenveto etukäteispassista |

Tunnustukset

Human-Centered AI Masters -ohjelmaa rahoitettiin Euroopan unionin Verkkojen Eurooppa -välineestä (CEF-TC-2020–1 Digital Skills 2020-EU-IA-0068).