Administrative oplysninger

| Titel | Fremskudt udbredelse |

| Varighed | 60 |

| Modul | B |

| Lektionstype | Forelæsning |

| Fokus | Teknisk — Dyb læring |

| Emne | Fremadkørsel |

Nøgleord

Fremkørsel, tab,

Læringsmål

- Forstå processen med en forward pass

- Forstå, hvordan man beregner en forward pass forudsigelse, samt tab unplugged

- Udvikle en forward pass ved hjælp af ingen moduler i Python (bortset fra Numpy)

- Udvikle en forward pass ved hjælp af Keras

Forventet forberedelse

Læringsbegivenheder, der skal fuldføres før

Ingen.

Obligatorisk for studerende

Ingen.

Valgfrit for studerende

- Multiplikation af matricer

- Kom i gang med Numpy

- Kendskab til lineær og logistisk regression (fra periode A Machine Learning): Forelæsning: Lineær regression, GLR'er, GAD'er)

Referencer og baggrund for studerende

- John D. Kelleher og Brain McNamee. (2018), Fundamentals of Machine Learning for Predictive Data Analytics, MIT Press.

- Michael Nielsen. (2015), Neural Networks and Deep Learning, 1. Beslutsomhed presse, San Francisco CA USA.

- Charu C. Aggarwal. (2018), Neural Networks and Deep Learning, 1. Springer

- Antonio Gulli, Sujit Pal. Dyb læring med Keras, Packt, [ISBN: 9781787128422].

Anbefalet til lærerne

Ingen.

Undervisningsmaterialer

Instruktioner til lærerne

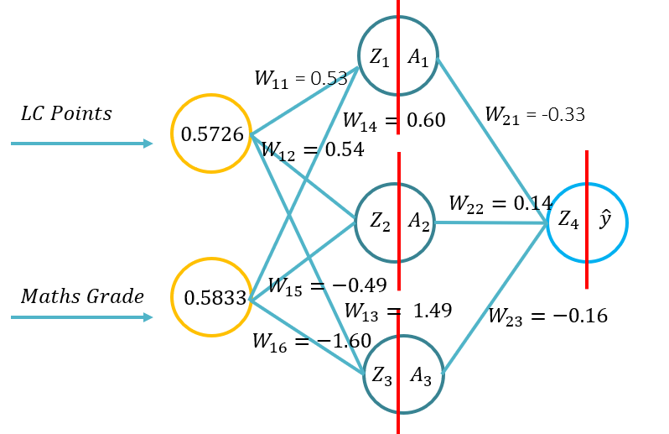

Dette foredrag vil introducere de studerende til de grundlæggende elementer i fremadrettet udbredelse for et kunstigt neuralt netværk. Dette vil introducere eleverne til topologien (vægte, synapser, aktiveringsfunktioner og tabsfunktioner). Studerende vil derefter være i stand til at gøre en forward pass ved hjælp af pen og papir, ved hjælp af Python med kun Numpy bibliotek (til matricer manipulation) og derefter bruge KERAS som en del af tutorial forbundet med denne LE. Dette vil opbygge en grundlæggende forståelse af, hvilke aktiveringsfunktioner der gælder for specifikke problemkontekster, og hvordan aktiveringsfunktionerne adskiller sig i beregningsmæssig kompleksitet. I forelæsningen undersøges den ydre lagaktiveringsfunktion og tilsvarende tabsfunktioner til brugstilfælde som binomialklassifikation, regression og multiklasseklassifikation.

- Oversigt over et neuralt netværk

- Definition af begreber/komponenter

- Vægte og aktiveringsfunktioner

- Tabsfunktioner, som en for hvilken problemkontekst

- Brug af matricer til at foretage en fremkørsel

Bemærkning:

- Brug af Sigmoid i det ydre lag og MSE som tabsfunktion.

- Med tine begrænsninger blev der valgt en unik tilgang/topologi/problemkontekst. Typisk ville man starte med regression for en forward pass (med MSE som tabsfunktion), og for at udlede backpropagation (således at have en lineær aktiveringsfunktion i outputlaget, hvor dette reducerer kompleksiteten af afledningen af backpropagation-funktionen), Så ville man typisk flytte til en binær klassifikationsfunktion, med sigmoid i outputlaget og en binær crossentropi tab funktion. Med tidsbegrænsninger vil dette sæt foredrag bruge tre forskellige eksempel skjulte aktiveringsfunktioner, men vil bruge en regression problem kontekst. For at tilføje kompleksiteten af en sigmoid aktiveringsfunktion i outputlaget, regressionsproblemet, der anvendes i de to første foredrag i dette sæt, er problemeksemplet baseret på en normaliseret målværdi (0-1 baseret på et procentvist problem 0-100 %), og sigmoid bruges således som en aktiveringsfunktion i outputlaget. Denne tilgang giver eleverne mulighed for nemt at migrere mellem regression og binære klassificeringsproblemer, ved blot at ændre tabsfunktionen, hvis et binært klassifikationsproblem, eller hvis et ikke-normaliseret regressionsproblem anvendes, fjerner den studerende simpelthen den ydre lagaktiveringsfunktion.

- Kernekomponenter er anvendelsen af et højt niveau bibliotek, i dette tilfælde KERAS via TensorFlow 2.X bibliotek.

- Pen og papir er valgfrit og bruges kun til at vise forward pass og backpropagation afledning og anvendelse (ved hjælp af eksemplerne fra foredrag dias).

- Python kode uden brug af højt niveau biblioteker, bruges til at vise, hvor simpelt et neuralt net (ved hjælp af eksemplerne fra foredrag dias). Dette giver også mulighed for diskussion om hurtig numerisk/matricer multiplikation og introducere hvorfor vi bruger GPU'er/TPU'er som et valgfrit element.

- Keras og TensorFlow 2.X bruges og vil blive brugt til alle fremtidige eksempler.

Omrids

| Varighed (min.) | Beskrivelse |

|---|---|

| 10 | Definition af neurale netværkskomponenter |

| 15 | Vægte og aktiveringsfunktioner (Sigmoid, TanH og ReLu) |

| 15 | Tabsfunktioner (Regression, binomial klassificering og aktivering af flere klasser) |

| 15 | Brug af matricer til en fremkørsel |

| 5 | Opsummering af forward pass |

Anerkendelser

Programmet Human-Centered AI Masters blev samfinansieret af Connecting Europe-faciliteten i Den Europæiske Union under tilskud CEF-TC-2020-1 Digital Skills 2020-EU-IA-0068.