Διοικητικές πληροφορίες

| Τίτλος | Προωθητική διάδοση |

| Διάρκεια | 60 |

| Ενότητα | Β |

| Είδος μαθήματος | Διάλεξη |

| Εστίαση | Τεχνική — Βαθιά Μάθηση |

| Θέμα | Κάρτα εισόδου προς τα εμπρός |

Λέξεις-κλειδιά

Μπροστινό πέρασμα, απώλεια,

Μαθησιακοί στόχοι

- Κατανοήστε τη διαδικασία ενός προθεσμιακού περάσματος

- Κατανοήστε πώς να υπολογίσετε μια πρόβλεψη επιτυχίας προς τα εμπρός, καθώς και απώλεια αποσυνδεδεμένη

- Αναπτύξτε ένα πέρασμα προς τα εμπρός χρησιμοποιώντας καμία ενότητα στην Python (εκτός από Numpy)

- Αναπτύξτε ένα μπροστινό πέρασμα χρησιμοποιώντας Keras

Αναμενόμενη προετοιμασία

Μαθησιακές εκδηλώσεις που πρέπει να ολοκληρωθούν πριν

Καμία.

Υποχρεωτικό για τους φοιτητές

Καμία.

Προαιρετικό για Φοιτητές

- Πολλαπλασιασμός πινάκων

- Ξεκινώντας με τον Numpy

- Γνώση γραμμικής και λογιστικής παλινδρόμησης (από την Περίοδο Α Μηχανικής Μάθησης): Διάλεξη: Γραμμική παλινδρόμηση, GLR, GADs)

Αναφορές και υπόβαθρο για τους μαθητές

- John D Kelleher και Brain McNamee. (2018), Fundamentals of Machine Learning for Predictive Data Analytics, MIT Press.

- Ο Μάικλ Νίλσεν. (2015), Neural Networks and Deep Learning (Νευρωνικά δίκτυα και βαθιά μάθηση), 1. Αποφασιστικότητα Τύπος, San Francisco CA ΗΠΑ.

- Charu C. Aggarwal. (2018), Neural Networks and Deep Learning (Νευρωνικά δίκτυα και βαθιά μάθηση), 1. Σπρίνγκερ

- Αντόνιο Γκούλι, Σουτζίτ Παλ. Βαθιά μάθηση με Keras, Packt, [ISBN: 9781787128422].

Συνιστάται για εκπαιδευτικούς

Καμία.

Υλικό μαθήματος

Οδηγίες για τους εκπαιδευτικούς

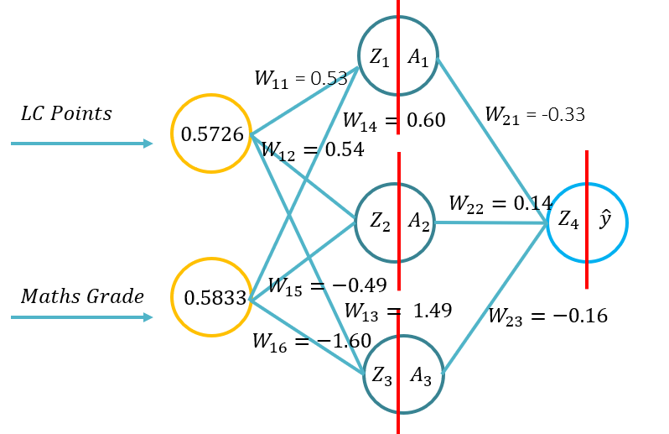

Αυτή η διάλεξη θα εισαγάγει τους μαθητές στις βασικές αρχές της μελλοντικής διάδοσης για ένα τεχνητό νευρωνικό δίκτυο. Αυτό θα εισαγάγει τους μαθητές στην τοπολογία (βάρη, συνάψεις, λειτουργίες ενεργοποίησης και λειτουργίες απώλειας). Στη συνέχεια, οι μαθητές θα είναι σε θέση να κάνουν ένα πέρασμα προς τα εμπρός χρησιμοποιώντας στυλό και χαρτί, χρησιμοποιώντας Python με μόνο τη βιβλιοθήκη Numpy (για χειρισμό πινάκων) και στη συνέχεια χρησιμοποιώντας το KERAS ως μέρος του φροντιστήριο που σχετίζεται με αυτό το LE. Αυτό θα οικοδομήσει θεμελιώδη κατανόηση των συναρτήσεων ενεργοποίησης που εφαρμόζονται σε συγκεκριμένα προβληματικά πλαίσια και πώς οι συναρτήσεις ενεργοποίησης διαφέρουν στην υπολογιστική πολυπλοκότητα. Στη διάλεξη η συνάρτηση ενεργοποίησης του εξωτερικού στρώματος και οι αντίστοιχες συναρτήσεις απώλειας θα εξεταστούν για περιπτώσεις χρήσης όπως διωνυμική ταξινόμηση, παλινδρόμηση και ταξινόμηση πολλαπλών κλάσεων.

- Επισκόπηση ενός νευρωνικού δικτύου

- Ορισμός όρων/συστατικών

- Βάρη και λειτουργίες ενεργοποίησης

- Συναρτήσεις απώλειας, για τις οποίες ένα πρόβλημα πλαίσιο

- Χρησιμοποιώντας μήτρες για να διεξάγετε ένα πέρασμα προς τα εμπρός

Σημείωση:

- Χρήση του Sigmoid στο εξωτερικό στρώμα και της MSE ως συνάρτηση απώλειας.

- Με περιορισμούς, επιλέχθηκε μια μοναδική προσέγγιση/τοπολογία/πρόβλημα. Συνήθως, κάποιος θα ξεκινήσει με την παλινδρόμηση για ένα προς τα εμπρός πέρασμα (με MSE ως συνάρτηση απώλειας), και για την εξαγωγή οπισθοπολλαπλασιασμού (έτσι έχει μια συνάρτηση γραμμικής ενεργοποίησης στο στρώμα εξόδου, όπου αυτό μειώνει την πολυπλοκότητα της παραγωγής της συνάρτησης οπισθοπολλαπλασιασμού), Στη συνέχεια, θα μετακινούνταν συνήθως σε μια συνάρτηση δυαδικής ταξινόμησης, με σιγμοειδές στο στρώμα εξόδου, και μια δυαδική συνάρτηση απώλειας σταυροειδούς εντέρου. Με χρονικούς περιορισμούς, αυτό το σύνολο διαλέξεων θα χρησιμοποιήσει τρεις διαφορετικές συναρτήσεις ενεργοποίησης, αλλά θα χρησιμοποιήσει ένα πλαίσιο προβλημάτων παλινδρόμησης. Για να προσθέσετε την πολυπλοκότητα μιας λειτουργίας σιγμοειδούς ενεργοποίησης στο στρώμα εξόδου, το πρόβλημα παλινδρόμησης που χρησιμοποιείται στις δύο πρώτες διαλέξεις αυτού του συνόλου, το παράδειγμα προβλήματος βασίζεται σε μια ομαλοποιημένη τιμή στόχου (0-1 με βάση ένα ποσοστιαίο πρόβλημα βαθμού 0-100 %), έτσι το σιγμοειδές χρησιμοποιείται ως συνάρτηση ενεργοποίησης στο στρώμα εξόδου. Αυτή η προσέγγιση επιτρέπει στους μαθητές να μεταναστεύσουν εύκολα μεταξύ παλινδρόμησης και δυαδικών προβλημάτων ταξινόμησης, αλλάζοντας απλώς τη συνάρτηση απώλειας μόνο εάν ένα δυαδικό πρόβλημα ταξινόμησης, ή εάν χρησιμοποιείται ένα μη ομαλοποιημένο πρόβλημα παλινδρόμησης, ο μαθητής απλώς αφαιρεί τη συνάρτηση ενεργοποίησης του εξωτερικού στρώματος.

- Βασικά στοιχεία είναι η εφαρμογή, χρησιμοποιώντας μια βιβλιοθήκη υψηλού επιπέδου, στην περίπτωση αυτή του ΚΕΡΑΣ μέσω της βιβλιοθήκης TensorFlow 2.X.

- Η πένα και το χαρτί είναι προαιρετικά και χρησιμοποιούνται μόνο για να δείξουν την παραγωγή και την εφαρμογή του μπροστινού περάσματος και της οπισθοπολλαπλασιασμού (χρησιμοποιώντας τα παραδείγματα από τις διαφάνειες διαλέξεων).

- Ο κώδικας Python χωρίς τη χρήση βιβλιοθηκών υψηλού επιπέδου, χρησιμοποιείται για να δείξει πόσο απλό είναι ένα νευρωνικό δίκτυο (χρησιμοποιώντας τα παραδείγματα από τις διαφάνειες διαλέξεων). Αυτό επιτρέπει επίσης τη συζήτηση σχετικά με το γρήγορο αριθμητικό/μητρικό πολλαπλασιασμό και παρουσιάζει γιατί χρησιμοποιούμε τις GPUs/TPU ως προαιρετικό στοιχείο.

- Keras και TensorFlow 2.X χρησιμοποιούνται και θα χρησιμοποιηθούν για όλα τα μελλοντικά παραδείγματα.

Σχεδιάγραμμα

| Διάρκεια (ελάχιστη) | Περιγραφή |

|---|---|

| 10 | Ορισμός των στοιχείων νευρωνικού δικτύου |

| 15 | Βάρη και λειτουργίες ενεργοποίησης (Sigmoid, TanH και ReLu) |

| 15 | Απωλειών συναρτήσεων (παλινδρόμηση, διωνυμική ταξινόμηση και ενεργοποίηση πολλαπλών κλάσεων) |

| 15 | Χρησιμοποιώντας μήτρες για ένα μπροστινό πέρασμα |

| 5 | Ανακεφαλαιώστε στο μπροστινό πέρασμα |

Αναγνωρίσεις

Το πρόγραμμα Μάστερ τεχνητής νοημοσύνης με επίκεντρο τον άνθρωπο συγχρηματοδοτήθηκε από τον μηχανισμό «Συνδέοντας την Ευρώπη» της Ευρωπαϊκής Ένωσης στο πλαίσιο της επιχορήγησης CEF-TC-2020-1 Digital Skills 2020-EU-IA-0068.