Informații administrative

| Titlu | Propagare înainte |

| Durată | 60 |

| Modulul | B |

| Tipul lecției | Prelegere |

| Focalizare | Tehnică – Învățare profundă |

| Subiect | Pas înainte |

Cuvinte cheie

Înainte pas, Pierdere,

Obiective de învățare

- Înțelegeți procesul unei treceri înainte

- Înțelegeți cum să calculați o predicție a trecerii înainte, precum și pierderea deconectată

- Dezvoltarea unei treceri înainte fără module în Python (altele decât Numpy)

- Dezvoltați o trecere înainte folosind Keras

Pregătirea preconizată

Evenimente de învățare care urmează să fie finalizate înainte

Nici unul.

Obligatoriu pentru studenți

Nici unul.

Opțional pentru studenți

- Multiplicarea matricelor

- Noțiuni de bază cu Numpy

- Cunoașterea regresiei liniare și logistice (din Perioada A Machine Learning): Prelegere: Regresie liniară, GLR-uri, GAD-uri)

Referințe și context pentru studenți

- John D Kelleher și Brain McNamee. (2018), Fundamentals of Machine Learning for Predictive Data Analytics, MIT Press.

- Michael Nielsen. (2015), Neural Networks and Deep Learning (Rețele neuronale și învățare profundă), 1. Presa de determinare, San Francisco CA SUA.

- Charu C. Aggarwal. (2018), Neural Networks and Deep Learning (Rețele neuronale și învățare profundă), 1. Springer

- Antonio Gulli, Sujit Pal. Deep Learning cu Keras, Packt, [ISBN: 9781787128422].

Recomandat pentru profesori

Nici unul.

Materiale de lecție

Instrucțiuni pentru profesori

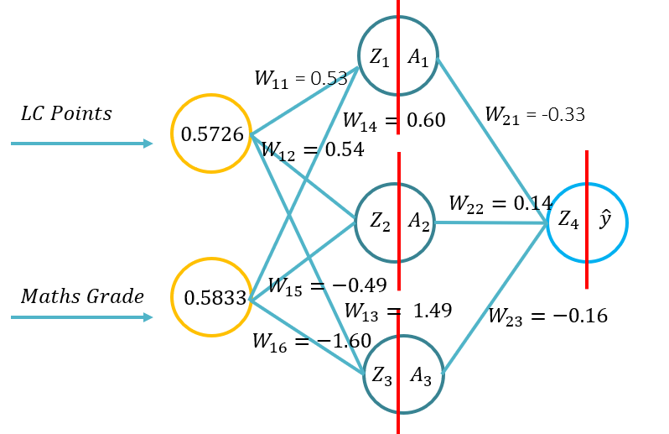

Această prelegere va introduce studenții la fundamentele propagării înainte pentru o rețea neuronală artificială. Acest lucru va introduce elevii la topologie (greutăți, sinapse, funcții de activare și funcții de pierdere). Elevii vor putea apoi să facă o trecere înainte folosind stiloul și hârtia, folosind Python numai cu biblioteca Numpy (pentru manipularea matricelor) și apoi folosind KERAS ca parte a tutorialului asociat cu acest LE. Acest lucru va construi o înțelegere fundamentală a funcțiilor de activare care se aplică contextelor de probleme specifice și a modului în care funcțiile de activare diferă în ceea ce privește complexitatea computațională. În prelegere, funcția de activare a stratului exterior și funcțiile de pierdere corespunzătoare vor fi examinate pentru cazuri de utilizare, cum ar fi clasificarea binomială, regresia și clasificarea în mai multe clase.

- Prezentare generală a unei rețele neuronale

- Definirea termenilor/componentelor

- Greutăți și funcții de activare

- Funcții de pierdere, care unul pentru care context de problemă

- Utilizarea matricelor pentru a efectua o trecere înainte

Notă:

- Utilizarea Sigmoid în stratul exterior și MSE ca funcție de pierdere.

- În cazul limitărilor dinților, a fost selectată o abordare singulară/topologie/context de problemă. În mod obișnuit, s-ar începe cu regresia pentru o trecere înainte (cu MSE ca funcție de pierdere) și pentru derivarea backpropagation (având astfel o funcție de activare liniară în stratul de ieșire, unde acest lucru reduce complexitatea derivării funcției backpropagation), Apoi s-ar trece de obicei la o funcție de clasificare binară, cu sigmoid în stratul de ieșire și o funcție binară de pierdere a entropiei. Cu constrângeri de timp, acest set de prelegeri va utiliza trei funcții diferite de activare ascunse, dar va utiliza un context de problemă de regresie. Pentru a adăuga complexitatea unei funcții de activare sigmoidă în stratul de ieșire, problema de regresie utilizată în primele două prelegeri ale acestui set, exemplul problemei se bazează pe o valoare țintă normalizată (0-1 bazată pe o problemă de grad procentual 0-100 %), astfel sigmoidul este utilizat ca funcție de activare în stratul de ieșire. Această abordare permite studenților să migreze cu ușurință între regresie și problemele de clasificare binară, prin simpla modificare a funcției de pierdere numai în cazul în care se utilizează o problemă de clasificare binară sau dacă se utilizează o problemă de regresie nenormalizată, studentul pur și simplu elimină funcția de activare a stratului exterior.

- Componentele de bază sunt aplicarea, folosind o bibliotecă de nivel înalt, în acest caz KERAS prin intermediul bibliotecii TensorFlow 2.X.

- Stiloul și hârtia sunt opționale și utilizate numai pentru a arăta derivarea și aplicarea pasului înainte și a backpropagation (folosind exemplele din diapozitivele de curs).

- Codul Python fără utilizarea bibliotecilor de nivel înalt este folosit pentru a arăta cât de simplu este o rețea neuronală (folosind exemplele din diapozitivele de curs). Acest lucru permite, de asemenea, discuții despre multiplicarea numerică/matrice rapidă și introducem motivul pentru care folosim GPU-uri/TPU-uri ca element opțional.

- Keras și TensorFlow 2.X sunt utilizate și vor fi utilizate pentru toate exemplele viitoare.

Contur

| Durată (min) | Descriere |

|---|---|

| 10 | Definirea componentelor rețelei neuronale |

| 15 | Greutăți și funcții de activare (Sigmoid, TanH și ReLu) |

| 15 | Funcții de pierdere (regresie, clasificare binomială și activare în mai multe clase) |

| 15 | Utilizarea matricelor pentru o trecere înainte |

| 5 | Recapitulare pe pasa înainte |

Confirmări

Programul de masterat AI centrat pe om a fost cofinantat de Mecanismul pentru interconectarea Europei al Uniunii Europene sub Grantul CEF-TC-2020-1 Digital Skills 2020-EU-IA-0068.